Budoucnost „ChatGPT‑momentu“ pro humanoidní roboty odložena na nejbližší deset let

Krátce o situaci v odvětví humanoidní robotiky

| Co se diskutuje | Kdo mluví | Klíčové myšlenky | Časový rámec průlomu |

|---|---|---|---|

| Van Xiaogan (Daxiao Robotics), Jensen Huang (Nvidia) | Průlom možný již za 2–3 roky díky škálování dat a simulacím. | 2–3 roky | |

| Shao Hao (Vivo) | Očekává se přibližně desetiletí, dokud nebudou k dispozici levná, různorodá reálná data. | Přibližně 10 let |

Současný stav

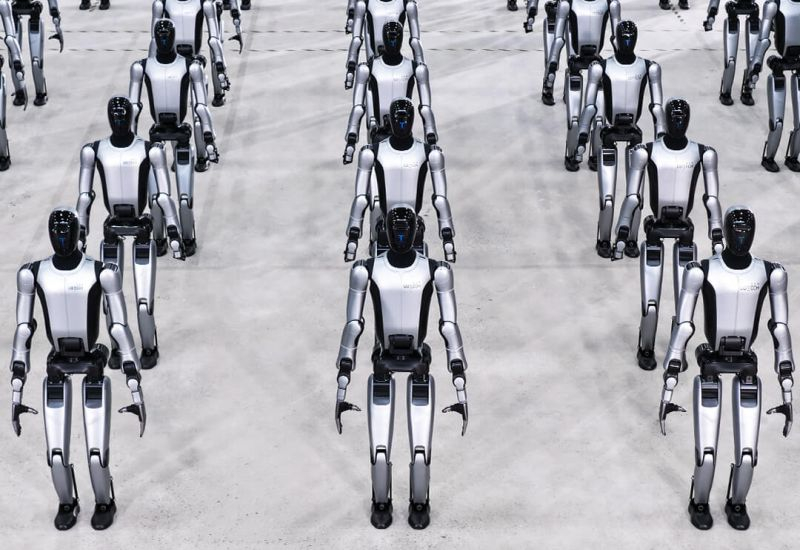

Čínští vývojáři demonstrovali choreografii a akrobacii na novoročním koncertu, ale pohyby byly „programovány“ a prováděny v kontrolovaném prostředí.

Problémy, které zůstávají

Všichni účastníci trhu:

1) Omezený přístup k velkému množství levných dat;

2) Stabilita a spolehlivost kinetických systémů;

3) Důvěra veřejnosti.

Etické a sociální otázky

Jenny Shipley (byla premiérka Nového Zélandu) říká, že lidé by neměli očekávat emocionální úsudky od robotů. Je nutné regulovat jejich funkce, zajistit bezpečnost dat a řídit odpovědnost.

Co se děje nyní

1. Dopad ChatGPT

Otevření modelu v roce 2022 změnilo IT trh a globální ekonomiku. Toto událost se stala „pulsem“ pro další vývoj AI.

2. Prognózy humanoidních robotů

- *Van Xiaogan* tvrdí, že za pár let lze dosáhnout významného pokroku, pokud zvýšíme objem dat a použijeme simulace světových modelů.

- *Jensen Huang* podporuje myšlenku digitálních dvojčat jako nástroje pro urychlení učení.

- *Shao Hao* považuje za nutné přibližně deset let kvůli nedostatku reálných dat.

3. Ukazatele v roce 2024

Čínské roboty předvedly akrobatické a bojové dovednosti na národním koncertu. Pohyby však byly „programovány“ podle vzorů živých choreografů a testy probíhaly ve statických podmínkách.

Klíčové bariéry

Bariéra | Proč je důležitá

---|---

Nedostatek levných dat | Bez velkého množství reálných pozorování se roboty nemohou přizpůsobit domácímu prostředí.

Spolehlivost pohybů | Stabilita a bezpečnost jsou kritické pro interakci s lidmi.

Veřejná důvěra | Lidé se obávají, že roboty budou přijímat emocionální rozhodnutí; je třeba transparentní regulace.

Jak se připravit na masové nasazení

1. Bezpečnostní standardy – vypracovat normy pro provoz a údržbu.

2. Sociální politiky – zajistit důstojné využití uvolněných lidských zdrojů.

3. Ochrana dat – sběr vizuálních a audio informací nesmí ohrozit kybernetickou bezpečnost.

Regulační příklad

Singapur již navrhl rámcové pravidla pro AI agenty, která mohou sloužit jako model pro robotiku. Jenny Shipley zdůrazňuje důležitost jasné struktury řízení a rozdělení odpovědnosti: „Nevím, kdo je teď za volantem“. To podtrhuje potřebu transparentnosti v řízení a regulaci nových technologií.

Závěr:

Vystoupení ChatGPT potvrdilo obrovský potenciál AI. V oblasti humanoidních robotů se prognózy rozdělují – od 2 do 10 let k reálnému průlomu. Momentálně jsou demonstrace působivé, ale pro praktické použití je potřeba rozsáhlá data, spolehlivost pohybů a veřejná důvěra, kterou lze zajistit pouze prostřednictvím bezpečnostních standardů a transparentní regulace.

Asted Cloud

Asted Cloud

Komentáře (0)

Podělte se o svůj názor — prosím, buďte slušní a držte se tématu.

Přihlaste se pro komentování