Nvidia vydala čip Groq 3 LPU, který zrychluje inferenci AI‑modelů až na úroveň tokenů.

Nvidia odhaluje nové možnosti platformy Vera Rubin

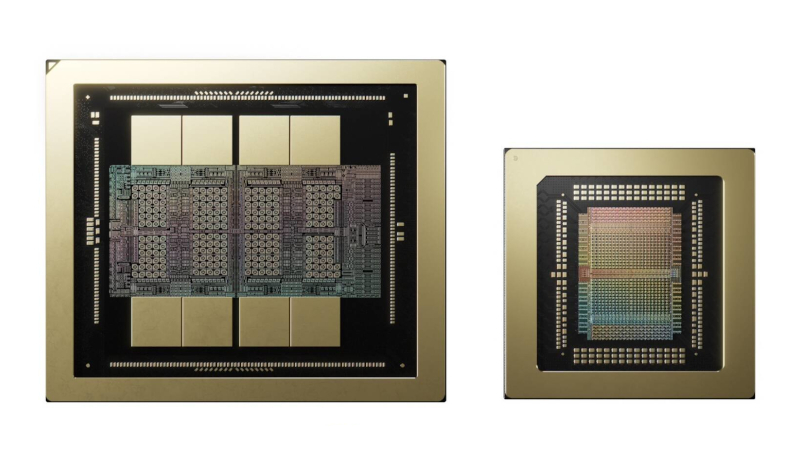

Na letošní konference GTC generální ředitel Nvidia Jen Sen Huang oznámil rozšíření platformy Vera Rubin. Základem nových funkcí je duševní vlastnictví získané od společnosti Groq a do Rubinu byl přidán čip *Groq 3 LPU* – akcelerátor inferenčních operací určený k vydávání tokenů vysokou rychlostí a nízkou latencí.

Co již existuje ve Vera Rubin

Platforma se skládá ze šesti klíčových komponent, které Nvidia sbírá do stojanových systémů a škáluje na velké AI továrny:

| Komponenta | Popis |

|---|---|

| GPU Rubin | Grafická karta s 288 GB HBM4 |

| CPU Vera | Centrální procesor |

| NVLink 6 | Systém intra-systémového škálování |

| ConnectX‑9 | Inteligentní síťový adaptér |

| BlueField‑4 | Procesor pro zpracování dat |

| Spectrum‑X | Přepínač inter-systémového škálování s integrovanou optikou |

Groq 3 LPU je nyní přidán jako nový stavební blok, který bude používán při nasazování velkých systémů.

Proč se Groq 3 LPU vynáší

Hlavním rozdílem je architektura paměti. Zatímco většina akcelerátorů využívá HBM jako pracovní paměť, každý Groq 3 LPU obsahuje 500 MB SRAM. Porovnání:

| Parametr | GPU Rubin (HBM4) | Groq 3 LPU (SRAM) |

|---|---|---|

| Kapacita | 288 GB | 0,5 GB |

| Propustnost | ~22 TB/s | do 150 TB/s |

Pro inferenční úlohy citlivé na propustnost je výhoda SRAM zřejmá. Proto Nvidia zahrnula Groq 3 do Rubinu – aby zvýšila rychlost vydávání tokenů.

Stojan Groq 3 LPX

V rámci stojanu se nachází 256 čipů Groq 3 LPU, což dává:

- 128 GB SRAM

- 40 PB/s celkové propustnosti

- 640 TB/s intra-systémového rozhraní

Viceprezident pro hyperškálovatelné řešení Ian Bak označil tento stojan jako coprocesor pro Rubin, zdůrazňujíc jeho roli v zvyšování výkonu dekódování na každé vrstvě modelu a tokenu.

Dopad na multiagentní systémy

Bak poznamenal, že Groq 3 LPX bude klíčovým prvkem pro budoucí AI trh – multiagentní systémy. Když agenti přenášejí data přímo, nikoli přes chatboty, mění se požadavky na odezvu: od 100 tokenů/s až po více než 1 500+ tokenů/s a výše.

Konkurenti a perspektivy

V textu je zmíněn konkurent – Cerebras, využívající Wafer‑Scale Engine (WSE) s obrovským SRAM pro nízkolatentní inferenci. OpenAI již zapojila Cerebras do svých pokročilých modelů díky výhodné latenci.

Bak také uvedl, že příchod Groq 3 LPU by mohl snížit závislost na akcelerátoru Rubin CPX. Zatímco Nvidia se zaměřuje na integraci stojanu Groq 3 LPX s platformou, oba čipy mají posílit inferenci bez nutnosti velkých objemů GDDR7 paměti.

Závěr:

Nový čip Groq 3 LPU a jeho stojan LPX posilují Vera Rubin v segmentu nízkolatentní inferenční, otevírají cestu k rychlejším multiagentním AI systémům a konkuruji hráčům jako Cerebras.

Asted Cloud

Asted Cloud

Komentáře (0)

Podělte se o svůj názor — prosím, buďte slušní a držte se tématu.

Přihlaste se pro komentování